眼动追踪对于AR眼镜的重要性不言而喻,现阶段用于AR头显的眼动追踪方案主要都是红外(IR)LED来实现的,但是精度并不算高,除非愿意在脖子上再加几斤铁倒是可以得到高精准度。

头戴式眼动追踪精度不高的问题,主要可以提到两点。我们写过很多文章,经常提到AR眼镜在户外运作的挑战,这次也不例外,户外的强光会对红外的效果产生影响,而且在户外广阔的视野的条件下,一点点的错误都会被放大无数倍,将会强烈的影响到用户体验感。在短距离下使用,就体现不出来这种缺点了。

其次,我们可以把人眼认为是一块凸镜,对于光线是有折射率的,这将导致光线弯曲。从而使得眼球位置、注视角度、瞳孔半径都产生了误差。而解决方案里其实是忽略了这一点,误差自然而然是出现了。这种误差通常能达到1度,甚至更多。

还不仅仅是凸面的关系这么简单,而是与眼角膜的性质有关。在角膜的顶部不会产生折射现象,而在角膜的底部,就会产生屈光现象(也就是发生折射)。

而且传统方案不会考虑到眼镜的滑动会对眼动追踪造成的影响。

Pupil Labs在其研究中则希望解决这些缺点,而且很轻便,只需要一个摄像头就可以完成这项任务了。让我们一起来看看吧。

采用了摄像头而不是红外,第一个问题自然而然就迎刃而解了。对于角膜而言,我们第一个要解决的是它折射率的问题,因为在不同的位置角膜的折射率是不同的。通过将眼球视为球形,通过数学模型计算,这就得出了各个位置上角膜的折射率。

对于眼球位置的估计,使用的方法是回归模型的方法,这种方法适合于3D眼睛模型的构建,并可以对注视进行估计。通过一个或多个摄像机从眼睛中获取的面部特征加上从模型中获取的眼睛特征,就可确定眼睛的相关参数。

至于注视方向的估计方法,使用的方法是利用3D眼睛模型进行估计的。传统方法也是 这样进行的,但是在考虑到眼睛的折射后,就不一样了,即虹膜的2D轮廓不再是3D虹膜的简单投影了,尤其是在一些角度更加倾斜的使用环境下。

对此,Pupil Labs抛弃前人的假设,使用的是单个相机的图像,来进行折射建模估计眼睛注视的方向。

要确定瞳孔的轮廓和半径,第一个就必须要找到瞳孔的中心。传统方法假设3D瞳孔的中心就是2D瞳孔的中心,这也是一个忽略了折射的一个简单假设。Pupil Labs在这里也同样抛弃前人的方法,使用其眼睛模型来估计。

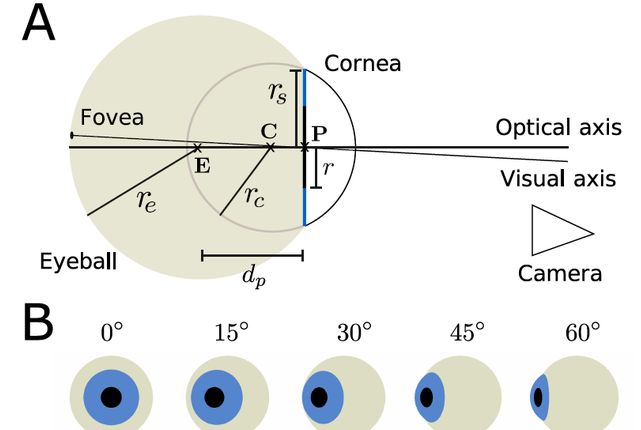

他们假设3D眼睛模型由两部分球体组成——眼球和角膜。眼球的中心位于E =(sx,sy,sz),曲率半径为rc,外层覆盖着不透明的巩膜。角膜的中心为C,曲率半径re,为透明。但是也为了便于计算,设定角膜内的房水为均匀介质,有效折射率n=1.3375,虹膜和瞳孔为同心圆,法线平行。光轴为EP线(通过校准获得),下面偏移的线就是视轴。

具体的模型计算丸子酱就不多言了(毕竟看不懂。。。大家看了也头大),直接来说结论吧。

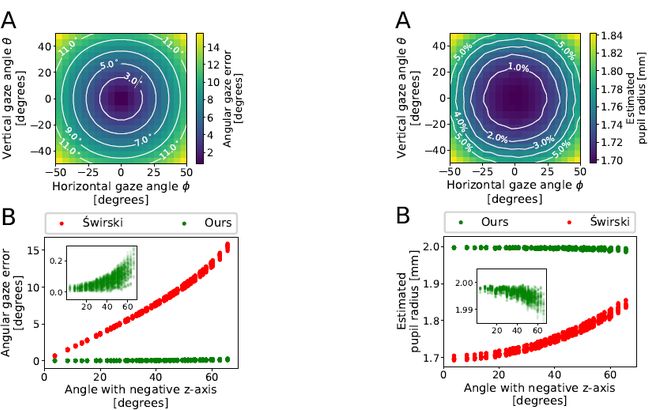

绿色的是Pupil Labs的数据,红色的另一个方案的对比组。

在注视角度变大的时候(也就是斜着眼睛看人),对比组误差指数型增长,甚至能达到15度的误差。而Pupil Labs的数据结果十分稳定,无论什么时候性能都十分良好。但是由于模型问题,还会存在离散误差,对结果的正确性有一定的影响,而且其模型还是存在一定的系统误差的。

Pupil Labs提出的新型眼动追踪方案,就传统方案忽略了眼角膜折射而造成的误差进行了改正。研究也证明红外方案的确会有较大误差和局限性,不顾Pupil Labs的方案似乎还存在一点点问题,不知道完善后能不能得到应用呢。

-

摄像头

+关注

关注

59文章

4840浏览量

95659 -

AR眼镜

+关注

关注

4文章

531浏览量

23157

原文标题:新型眼动追踪,精度更高

文章出处:【微信号:ARchan_TT,微信公众号:AR酱】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

STM32F4时钟树的重要性

电源对电子设备的重要性

时钟的重要性

时钟系统的重要性

当前5G对于智慧城市建设的重要性不言而喻

眼动追踪将是下一代VR头显非常重要的一项威廉希尔官方网站

眼动追踪集成的眼镜,可将数据带入任何场景

废旧电池拆解回收重要性

眼动追踪威廉希尔官方网站 初显潜力 落地还需硬件推广

随着人工智能的发展,少儿编程的重要性已不言而喻

浅谈硬件测试的重要性

苹果新专利揭示其眼动追踪系统

BMS电池管理系统的重要性

眼动追踪对于AR眼镜的重要性不言而喻

眼动追踪对于AR眼镜的重要性不言而喻

评论