AI将如何改变PC市场格局,以及对内存和存储的影响

AI几乎已经无处不在。每一天,我们都能看到或听到AI的新进展,或者使用由AI驱动的应用。从智能助手到自动驾驶汽车,AI正在改变人类与世界互动的方式。当AI与PC相结合,将为我们带来什么?AI能否让PC变得更智能、运行速度更快、更好地满足我们的个性化需求?在本篇博客中,我们将探讨AI如何改变PC市场格局,以及对内存和存储的影响。在2024年美国国际消费电子展 (CES) 上,所有热门话题都围绕AI展开,超过50% 的报道都与AI有关。

AI的背后是各种大语言模型 (LLM) ,这些模型的开发基于人类过往积累的海量未标记文本。您可以使用自然语言向LLM提问,它们能以同样自然的语言做出回答,就像人类之间的交互一样。这种能力建立在具有数十亿个参数的神经网络之上,在某些情况下,多个神经网络连接在一起,合作生成内容。当前最热门的LLM是ChatGPT和DALL-E,它们能够根据用户输入的提示,生成仿佛真人作答的文本内容,亦或是逼真且富有创意的图像。为实现这些令人惊叹的功能,LLM需要海量的算力和数据。因此,目前的LLM大都托管在云端,那里有它们需要的大量硬件基础设施和网络带宽。

但是,AI的实现之地不应局限在云端。将部分AI处理过程转移到边缘设备(即用户端设备)上,具有很多优势。例如,边缘AI处理可减少网络延迟、保护用户隐私、节省网络成本,还支持在离线状态使用AI功能。设想一下,如果可以使用自己的PC生成高质量内容、编辑照片和视频、转录语音、过滤噪音、识别人脸等等,而无需依赖云,是不是将更加方便和灵活?

为何看好AI PC?

PC并非唯一可从边缘AI威廉希尔官方网站 中受益的设备。智能手机、平板电脑、智能手表和其他小型电子设备也可利用AI来增强功能和性能。相比之下,PC具有一些独特优势,使其成为更适合边缘AI落地的平台。首先,PC拥有更大的屏幕,可显示更多信息,能够提供更好的用户体验。其次,PC拥有更大容量的电池,可运行更多需要更长时间的AI任务。第三,PC拥有更强的计算能力,可运行更复杂、对算力要求更高的AI模型。

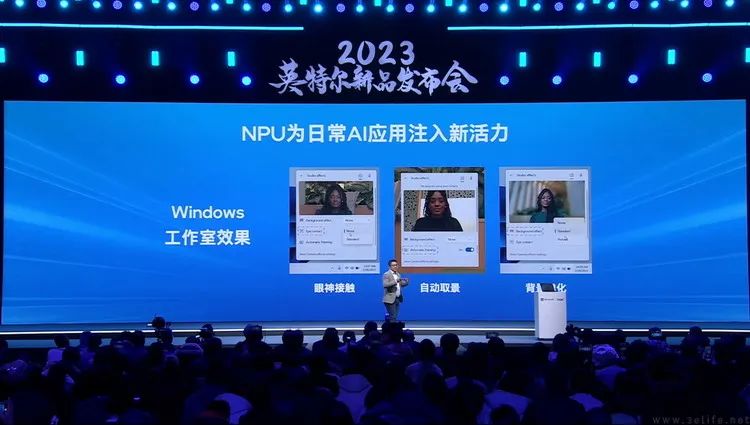

芯片制造商和软件开发商正在利用PC的这些优势。英特尔、AMD、高通、联发科和Nvidia等公司正在其面向PC平台的CPU和芯片组中嵌入性能越来越强的神经处理引擎和/或集成显卡,可提供数十TOPS(每秒万亿次操作)的AI性能。微软表示,今年发布的Windows 11操作系统新版本将利用CPU中内嵌的AI引擎进行优化。微软在AI时代的野心不难理解,该公司正在大力推广旗下的Copilot,这是一项利用AI威廉希尔官方网站 帮助用户编写代码、调试错误并提出改进建议的功能。一些头部厂商还积极与独立软件供应商 (ISV) 合作,帮助ISV推出更多AI优化的应用和功能,包括增强的视频会议体验、照片编辑、语音到文本转换、背景环境和噪音抑制,以及面部识别等等。这些正在开发中的应用将会给我们带来怎样的惊喜?是否会出现“杀手级应用”?一切尚需观察。但目前确实存在一些重要的现实问题。例如,如何才能在PC上高效运行AI模型?以及……

AI PC需要什么样的硬件?

在PC上运行AI模型的主要挑战之一是模型的大小。AI模型(尤其是LLM)可能有数十亿甚至数万亿个参数,需要大量存储空间和内存来存储和加载。美光的内部实验表明,一个拥有700亿个参数、4位精度的Llama2模型(用于自然语言生成的主流LLM)需要大约42GB的内存才能完成加载并执行推理,输出速度为每秒1.4个Token,而普通PC无法提供这么多的内存。这种矛盾是问题的核心,也为AI PC的未来指明了方向。未来将会出现针对特定功能的模型,可在保持准确性的同时减小模型的大小。未来的模型很可能会分化。700亿参数级别的大模型可用于内存和存储空间较大的高级系统,运行经过精细微调并针对对话用例进行优化的应用(如聊天补全)。此外,本地设备上的个人助理也可能需要大参数模型。少于100亿参数的模型可用于主流设备,托管模型所需的内存增加量较少(大约2GB),可用于文本补全、完成列表以及分类等语言类任务。

很显然,不同大小的模型需要与之相匹配的内存容量,至少对PC而言如此。除了容量之外,内存的带宽和能效同样非常重要。随着PC(尤其是移动设备)的内存从DDR转向LPDDR,带宽和能效均不断提升。例如,与DDR5相比,LPDDR5X在主动使用期间的功耗降低了44-54%,自刷新期间的功耗降低了86%。DDR5的带宽为4.8Gb/s,而LPDDR5带宽高达6.4Gb/s。如果AI能够快速进入PC,那么LPDDR5也将加速普及。如果将部分处理过程转移到内存中,还可进一步提高能源效率,相关研究和开发工作正在进行中。这个过程可能需要很长时间,也可能永远无法实现。行业需要融合各厂商的威廉希尔官方网站 ,形成一组通用的原语,用来将任务卸载到内存中,并需要开发相关的软件堆栈。任何一组给定原语,很难做到对所有应用都是最佳选择。因此,我们可以说,目前PC上的“存内处理”威廉希尔官方网站 还处在“问题多于答案”阶段。

一个更重要的问题是:AI模型的最佳切入点在哪里?如果模型仍然相对较大,有没有办法减少对内存的依赖,将部分模型放在存储设备里?如果这种办法可行,则需要增加存储带宽,以满足模型数据轮换加载的需求。这种情况可能促进Gen5 PCIe存储设备在主流PC中的普及,或者加速Gen6 PCIe存储设备的引入。近日Apple就该主题1发表了一篇论文:“闪存中的LLM:在有限内存中进行高效的大型语言模型推理”(作者:Alizadeh等),提出了一种在容量大于可用DRAM的设备上运行大型语言模型 (LLM) 的方法。论文作者建议将模型参数存储在闪存中,然后根据需要将它们加载到DRAM中。他们还提出了多种优化数据传输量以及提升读取吞吐量的方法,以大幅提高推理速度。论文中,用于评估各种闪存加载策略的主要指标是延迟,并分为三个不同的部分来讨论:从闪存加载数据的I/O成本;使用新加载数据时的内存管理开销;以及推理操作的计算成本。总之,该论文提出了将模型参数存储在闪存中,然后根据需要载入DRAM的方法,为“有效运行超过可用DRAM容量的LLM”这一难题提供了一种解决方案。

PC中的AI能力仍在不断发展中。当前将嵌入式NPU集成到CPU和独立GPU中的方案仅仅只是开始。Kinara、Memryx和Hailo推出的AI加速卡,为在PC中卸载AI工作负载提供了一种替代实现方式。模型方面,一种可能的发展方向是面向特定功能的模型。此类模型体积较小,并且针对特定功能进行了优化。这些模型可根据需要从存储设备载入内存,但对存储设备性能的要求类似于大型模型。

独立NPU的优势包括:

·可处理复杂的AI模型和任务,功耗和发热量比CPU和GPU更低。

·可为图像识别、生成式AI、聊天机器人和其他应用提供更快、更准确的AI处理性能。

·可加强现有CPU和GPU的功能,增强用户的整体AI体验。

联想将在2024年6月推出的ThinkCentre Neo Ultra台式机中搭载NPU加速卡,并称这些卡能够提供更强大的AI处理能力,且更加节能,优于当前的CPU和GPU解决方案。2

将TOPS作为AI硬件性能评估的唯一标准,可能并不全面。就AI计算而言,更重要的是单位时间内的推理次数、准确度和能源效率。对于生成式AI,关注的指标可能是每秒输出的Token数量,或者是在几秒内完成稳定扩散的能力。以行业普遍接受的方式测量这些指标,需要开发相关的基准测试程序。典型案例:在本届CES上,我参观了所有CPU供应商、独立NPU供应商的展位和演示。在每个演示中,厂商都声称他们的实现方式在某方面具有优势。

各方对于AI PC的横空出世确实充满热情和期待。PC OEM厂商将此视为一大卖点,希望AI PC能够刺激PC更新换代,自己能够借此获取更高利润。英特尔称到2025年AI PC的出货量将达到1亿台,几乎占整个PC总潜在市场的30%。无论最终的市场占有率如何,对消费者而言,2024年推出的AI PC还是值得期待的。

本文作者:Prasad Alluri

VP and GM for Client Storage at SBU

-

PC

+关注

关注

9文章

2080浏览量

154171 -

内存

+关注

关注

8文章

3023浏览量

74029 -

硬件

+关注

关注

11文章

3322浏览量

66208 -

AI

+关注

关注

87文章

30817浏览量

268968

原文标题:AI PC:PC行业的颠覆性变革?

文章出处:【微信号:gh_195c6bf0b140,微信公众号:Micron美光科技】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

蓝牙信道探测威廉希尔官方网站 或改变UWB市场格局

微软高管谈AI将如何改变工作方式

高通XPlus 8核亮相IFA2024,或重塑AI PC市场格局

2026年AI PC市场将占Windows PC半壁江山

AI PC:真正的AI PC,敢于下场

苹果新款iPad搭载OLED屏与AI芯片,争夺AI PC新市场

联想4月18日发布AI PC新品,引领AI PC时代

AI PC产品密集发布,预计2025年AI PC占全球PC出货量40%

AI将如何改变PC市场格局

AI将如何改变PC市场格局

评论