有理论基础,我们就可以进行深度优化了。为什么 transformer 性能这么好?它给众多大语言模型带来的上下文学习 (In-Context Learning) 能力是从何而来?在人工智能领域里,transformer 已成为深度学习中的主导模型,但人们对于它卓越性能的理论基础却一直研究不足。 最近,来自 Google AI、苏黎世联邦理工学院、Google DeepMind 研究人员的新研究尝试为我们揭开谜底。在新研究中,他们对 transformer 进行了逆向工程,寻找到了一些优化方法。论文《Uncovering mesa-optimization algorithms in Transformers》:

。 该研究的贡献包括:

。 该研究的贡献包括:

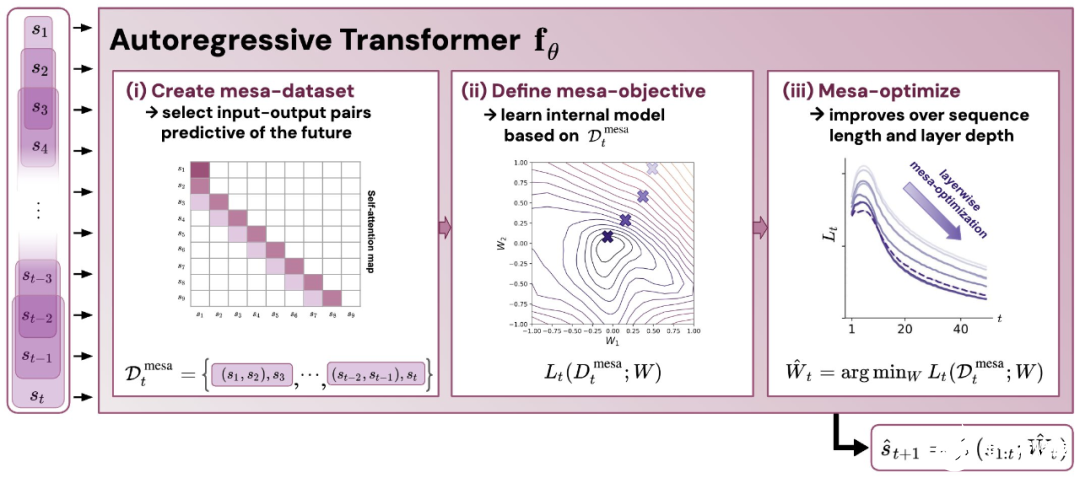

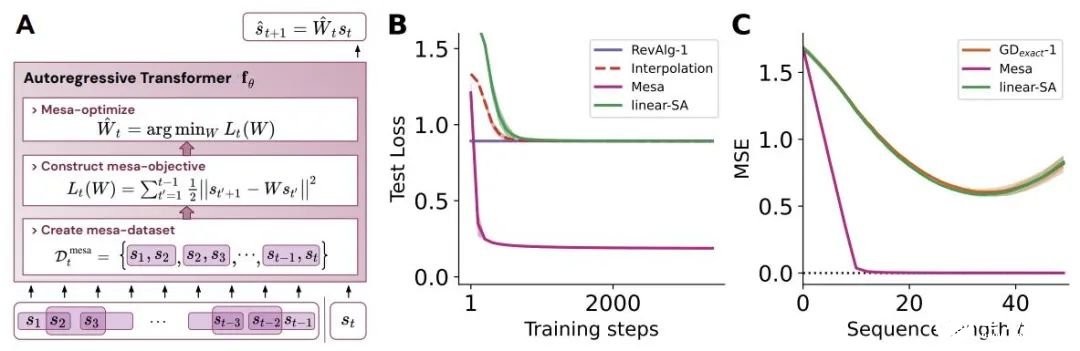

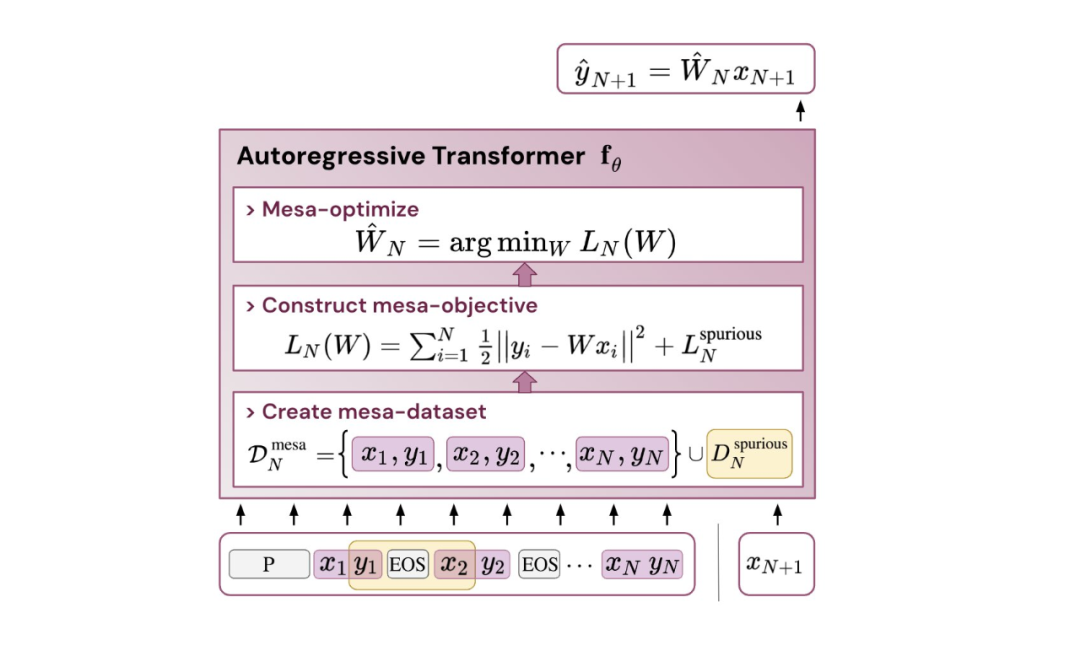

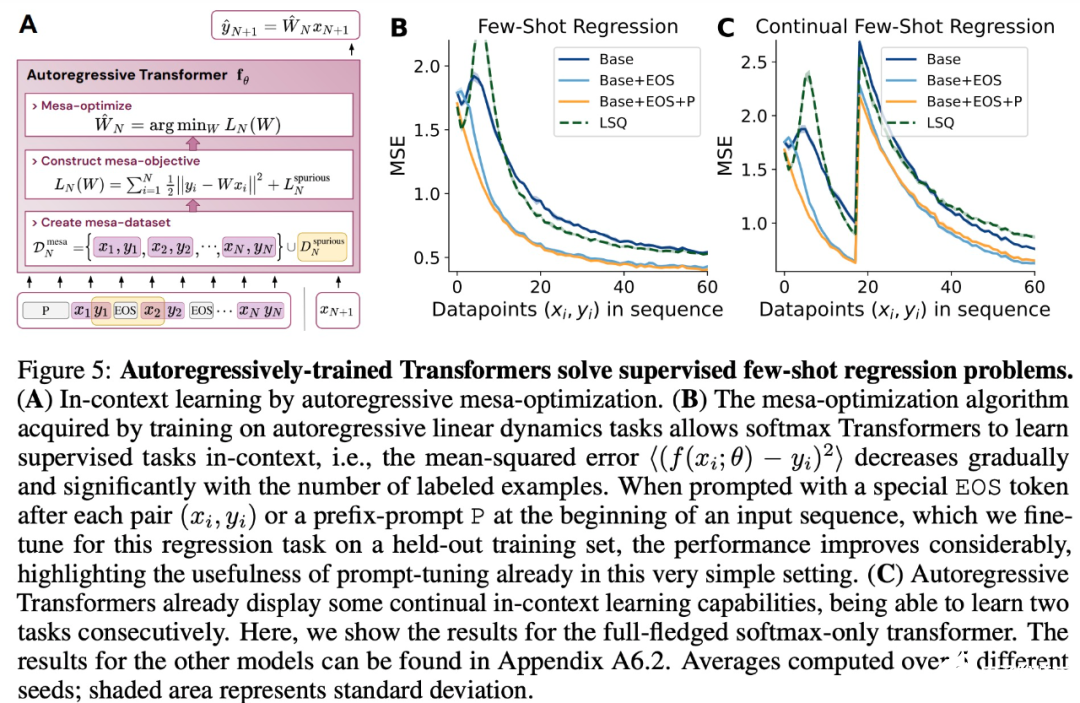

- 概括了 von Oswald 等人的理论,并展示了从理论上,Transformers 是如何通过使用基于梯度的方法优化内部构建的目标来自回归预测序列下一个元素的。

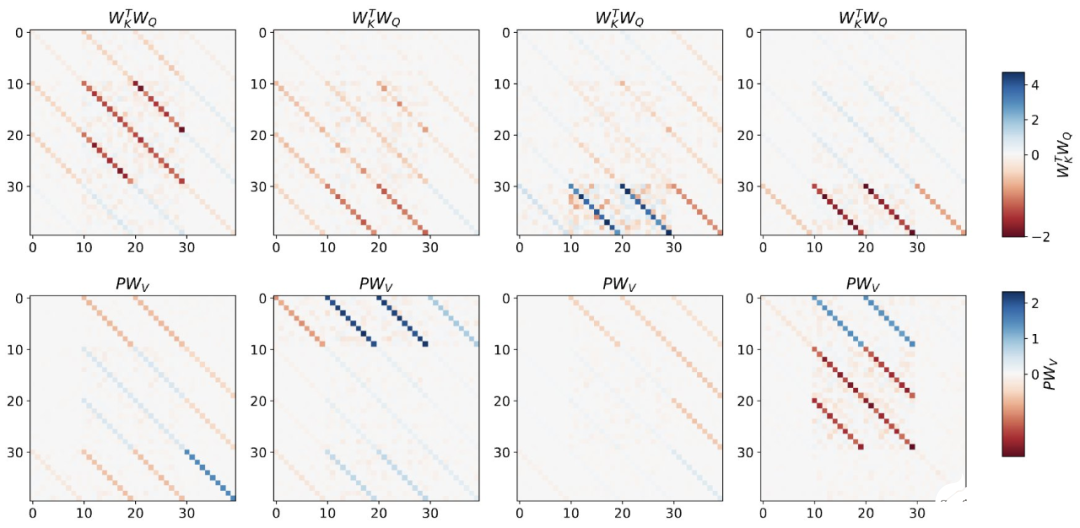

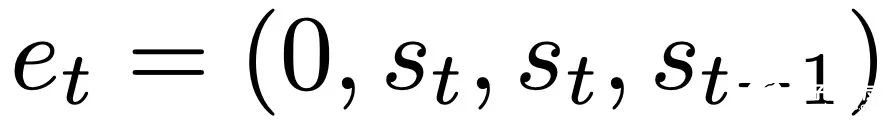

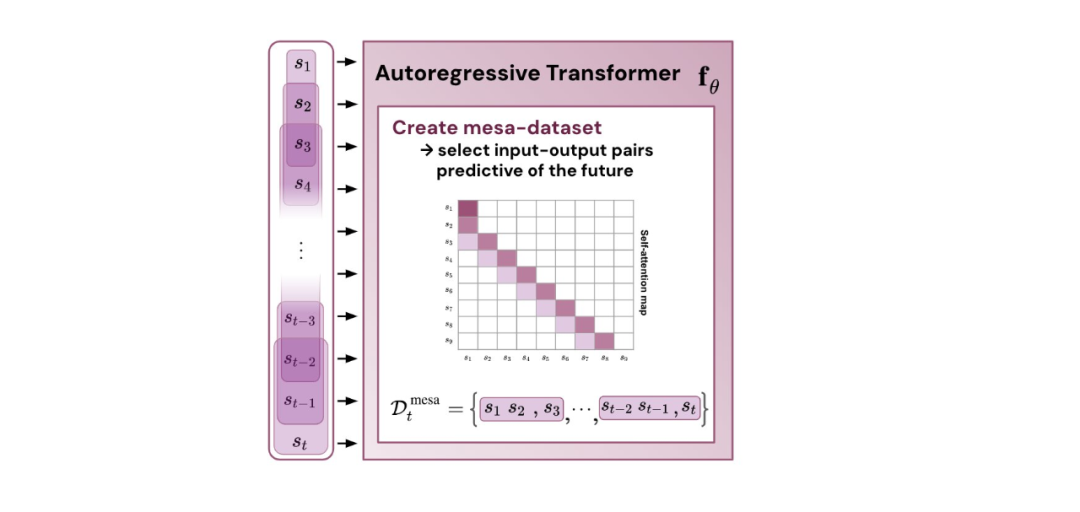

- 通过实验对在简单序列建模任务上训练的 Transformer 进行了逆向工程,并发现强有力的证据表明它们的前向传递实现了两步算法:(i) 早期自注意力层通过分组和复制标记构建内部训练数据集,因此隐式地构建内部训练数据集。定义内部目标函数,(ii) 更深层次优化这些目标以生成预测。

- 与 LLM 类似,实验表明简单的自回归训练模型也可以成为上下文学习者,而即时调整对于改善 LLM 的上下文学习至关重要,也可以提高特定环境中的表现。

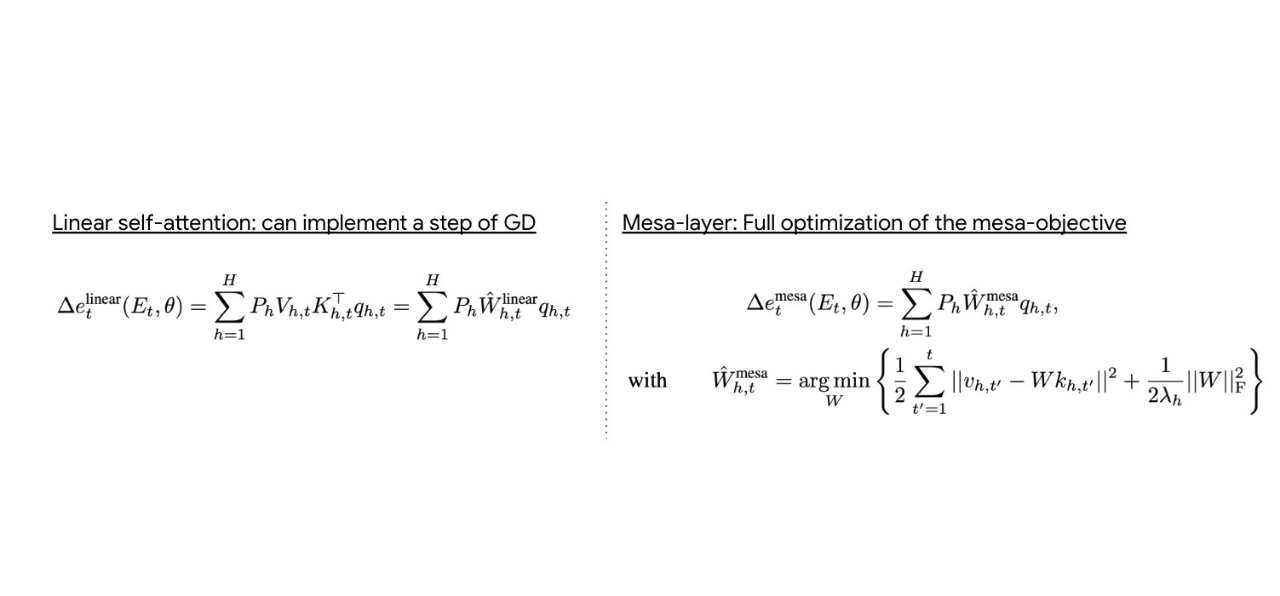

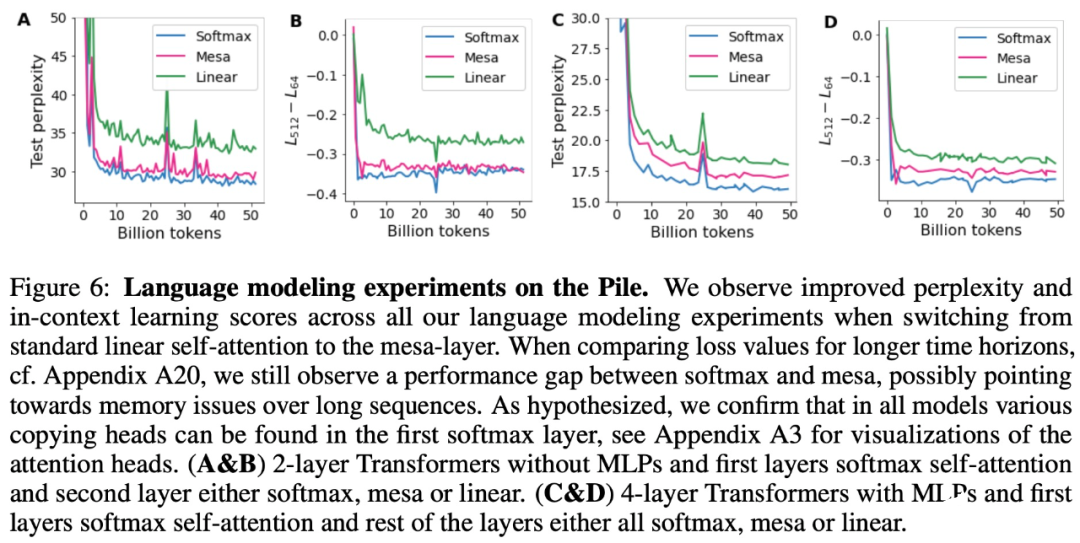

- 受发现注意力层试图隐式优化内部目标函数的启发,作者引入了 mesa 层,这是一种新型注意力层,可以有效地解决最小二乘优化问题,而不是仅采取单个梯度步骤来实现最优。实验证明单个 mesa 层在简单的顺序任务上优于深度线性和 softmax 自注意力 Transformer,同时提供更多的可解释性。

- 在初步的语言建模实验后发现,用 mesa 层替换标准的自注意力层获得了有希望的结果,证明了该层具有强大的上下文学习能力。

,这对应于选择 W_0 = 0。

,这对应于选择 W_0 = 0。

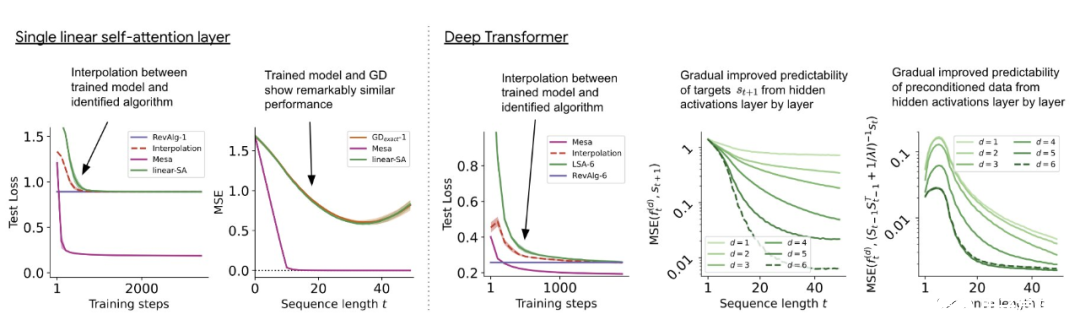

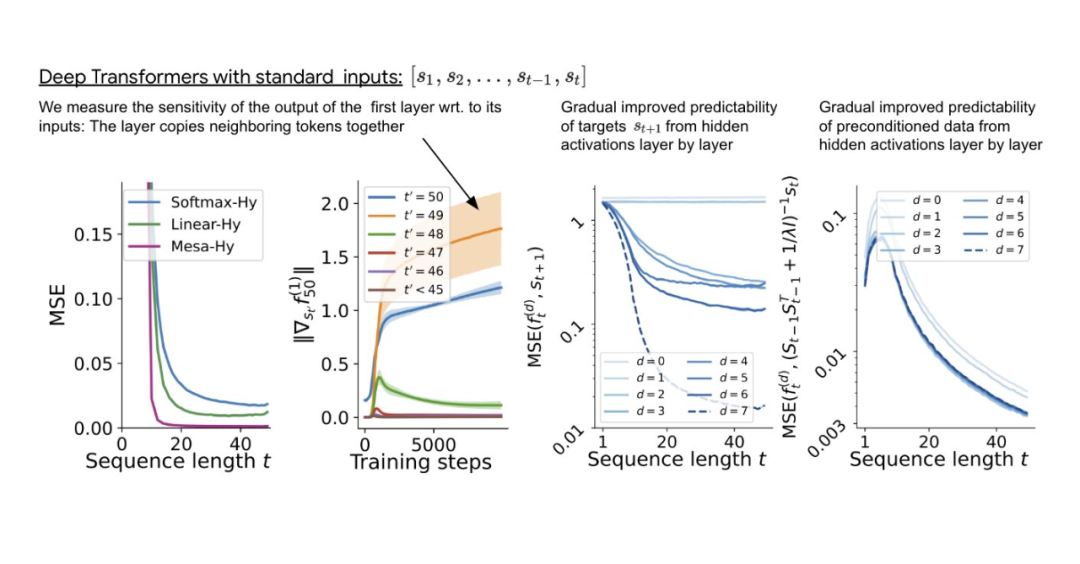

与单层模型一样,作者在训练模型的权重中看到了清晰的结构。作为第一个逆向工程分析,该研究利用这个结构并构建一个算法(RevAlg-d,其中 d 表示层数),每个层头包含 16 个参数(而不是 3200 个)。作者发现这种压缩但复杂的表达式可以描述经过训练的模型。特别是,它允许以几乎无损的方式在实际 Transformer 和 RevAlg-d 权重之间进行插值。 虽然 RevAlg-d 表达式解释了具有少量自由参数的经过训练的多层 Transformer,但很难将其解释为 mesa 优化算法。因此,作者采用线性回归探测分析(Alain & Bengio,2017;Akyürek et al.,2023)来寻找假设的 mesa 优化算法的特征。 在图 3 所示的深度线性自注意力 Transformer 上,我们可以看到两个探针都可以线性解码,解码性能随着序列长度和网络深度的增加而增加。因此,基础优化发现了一种混合算法,该算法在原始 mesa-objective Lt (W) 的基础上逐层下降,同时改进 mesa 优化问题的条件数。这导致 mesa-objective Lt (W) 快速下降。此外可以看到性能随着深度的增加而显着提高。 因此可以认为自回归 mesa-objective Lt (W) 的快速下降是通过对更好的预处理数据进行逐步(跨层)mesa 优化来实现的。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

人工智能

+关注

关注

1791文章

47207浏览量

238279 -

深度学习

+关注

关注

73文章

5500浏览量

121117 -

DeepMind

+关注

关注

0文章

130浏览量

10850 -

Transformer

+关注

关注

0文章

143浏览量

5997 -

大模型

+关注

关注

2文章

2427浏览量

2647

原文标题:Transformer的上下文学习能力是哪来的?

文章出处:【微信号:tyutcsplab,微信公众号:智能感知与物联网威廉希尔官方网站 研究所】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

SystemView上下文统计窗口识别阻塞原因

SystemView工具可以记录嵌入式系统的运行时行为,实现可视化的深入分析。在新发布的v3.54版本中,增加了一项新功能:上下文统计窗口,提供了对任务运行时统计信息的深入分析,使用户能够彻底检查每个任务,帮助开发人员识别阻塞原因。

【《大语言模型应用指南》阅读体验】+ 基础知识学习

的信息,提供更全面的上下文理解。这使得模型能够更准确地理解复杂问题中的多个层面和隐含意义。

2. 语义分析

模型通过训练学习到语言的语义特征,能够识别文本中的命名实体、句法结构和语义关系等信息。这些

发表于 08-02 11:03

Transformer能代替图神经网络吗

Transformer作为一种在处理序列数据方面表现出色的深度学习模型,自其提出以来,已经在自然语言处理(NLP)、时间序列分析等领域取得了显著的成果。然而,关于Transformer是否能完全代替图神经网络(GNN)的问题,需

Transformer语言模型简介与实现过程

在自然语言处理(NLP)领域,Transformer模型以其卓越的性能和广泛的应用前景,成为了近年来最引人注目的威廉希尔官方网站

之一。Transformer模型由谷歌在2017年提出,并首次应用于神经机器翻译

使用PyTorch搭建Transformer模型

Transformer模型自其问世以来,在自然语言处理(NLP)领域取得了巨大的成功,并成为了许多先进模型(如BERT、GPT等)的基础。本文将深入解读如何使用PyTorch框架搭建Transformer模型,包括模型的结构、训练过程、关键组件以及实现细节。

鸿蒙Ability Kit(程序框架服务)【应用上下文Context】

[Context]是应用中对象的上下文,其提供了应用的一些基础信息,例如resourceManager(资源管理)、applicationInfo(当前应用信息)、dir(应用文件路径)、area

编写一个任务调度程序,在上下文切换后遇到了一些问题求解

大家好,

我正在编写一个任务调度程序,在上下文切换后遇到了一些问题。

为下一个任务恢复上下文后:

__builtin_tricore_mtcr_by_name(\"pcxi\"

发表于 05-22 07:50

微信大模型扩容并开源,推出首个中英双语文生图模型,参数规模达15亿

基于Diffusion Transformer的混元DiT是一种文本到图像生成模块,具备中英细粒度理解能力,能与用户进行多轮对话,根据上下文生成并完善图像。

大语言模型:原理与工程时间+小白初识大语言模型

解锁

我理解的是基于深度学习,需要训练各种数据知识最后生成自己的的语言理解和能力的交互模型。

对于常说的RNN是处理短序列的数据时表现出色,耳真正厉害的是Transformer,此框架被推出后直接

发表于 05-12 23:57

【大语言模型:原理与工程实践】大语言模型的基础威廉希尔官方网站

Transformer有效避免了CNN中的梯度消失和梯度爆炸问题,同时提高了处理长文本序列的效率。此外,模型编码器可以运用更多层,以捕获输入序列中元素间的深层关系,并学习更全面的上下文向量表示。

预训练语言模型

发表于 05-05 12:17

TC397收到EVAL_6EDL7141_TRAP_1SH 3上下文管理EVAL_6EDL7141_TRAP_1SH错误怎么解决?

我收到EVAL_6EDL7141_TRAP_1SH 3 类(TIN4-Free 上下文列表下溢)上下文管理EVAL_6EDL7141_TRAP_1SH错误。 请告诉我解决这个问题的办法。

发表于 03-06 08:00

ISR的上下文保存和恢复是如何完成的?

函数:ifxCPU_enableInterrupts ();如果我让更高优先级的 ISR 中断优先级较低的 ISR,那么 ISR 的上下文保存和恢复是如何完成的?

发表于 01-22 06:28

为什么transformer性能这么好?Transformer的上下文学习能力是哪来的?

为什么transformer性能这么好?Transformer的上下文学习能力是哪来的?

评论