AI软件初创公司Mipsology正在与Xilinx合作,以使FPGA能够仅使用一个附加命令即可替换AI加速器应用程序中的GPU。Mipsology的“零努力”软件Zebra将GPU代码转换为可在FPGA上的Mipsology的AI计算引擎上运行,而无需进行任何代码更改或重新培训。

赛灵思今天宣布,将为数据中心向Zebra交付最新版本的Alveo U50卡。Zebra已经在其他Xilinx板上支持推理加速,包括Alveo U200和Alveo U250。

Xilinx营销副总裁Ramine Roane表示:“ Zebra带给我们的Alveo卡的加速水平使CPU和GPU加速器感到羞愧。”“与Zebra结合使用,Alveo U50满足了AI工作负载的灵活性和性能需求,并为任何部署提供了高吞吐量和低延迟性能优势。”

过去,即插即用的FPGA对于非专业人士来说很难编程,但是Mipsology希望将FPGA变成即插即用的解决方案,就像CPU或GPU一样容易使用。这样做的想法是使从其他类型的加速切换到FPGA尽可能容易。

Mipsology首席执行官Ludovic Larzul说:“最好的方式是[Mipsology],我们使用FPGA之上的软件来使它们透明化,就像Nvidia用Cuda CuDNN来使GPU对AI用户完全透明一样。“在接受EE Times采访时。

至关重要的是,这可以由非专家完成,而无需具备深厚的AI专业知识或FPGA技能,因为无需进行模型再培训即可过渡。

“易用性非常重要,因为当您查看人们的AI项目时,他们通常无法访问设计神经网络的AI团队,” Larzul说。“通常,如果有人安装了一个机器人系统或一个视频监视系统……他们会让其他团队或其他团体开发神经网络并对其进行培训。一旦获得了[训练有素的模型],他们就不会更改它,因为他们没有专业知识。”

与Xilinx对比当Xilinx

已经拥有自己的神经网络加速器引擎(XDNN)时,为什么会支持第三方软件?

“一句话的重点是:我们做得更好,”拉尔祖尔说。“另一句话是:我们的作品。”

Mipsology在Zebra中拥有自己的计算引擎,该引擎支持客户现有的卷积神经网络(CNN)模型,与XDNN不同,Larzul表示XDNN支持大量演示,但不太适合定制神经网络。他说,这使使用XDNN建立和运行自定义网络“痛苦”。尽管XDNN可以在不受GPU威胁的应用程序中竞争,但Zebra旨在使FPGA根据性能,成本和易用性直接采用GPU。

Larzul说,大多数客户改变GPU解决方案的动机是成本。

他说:“他们想降低硬件成本,但又不想重新设计神经网络。”“(避免了)一笔非经常性的费用,因为我们能够透明地替换GPU,并且无需重新训练或修改神经网络。”

FPGA还具有可靠性,部分原因是因为它们在芯片领域不那么积极,并且通常比包括GPU在内的其他加速器类型运行温度更低。这在需要长期维护成本的数据中心中尤其重要。

拉尔祖尔说:“总拥有成本不仅仅是董事会的价格。”“确保系统正常运行还需要付出代价。”

Zebra还旨在使FPGA在性能上竞争。Larzul说,尽管FPGA通常提供比其他加速器更少的TOPS(每秒Tera操作),但由于Zebra精心设计的计算引擎,它们能够更有效地使用TOPS。

“这是大多数加速AI的ASIC初创企业都忘记了的-他们在做很大的一块硅片,试图包装更多的TOPS,但是他们没有考虑如何在网络上映射它以提高效率”,他说,并指出Zebra的基于FPGA的引擎比TOPS量为6倍的GPU每秒能够处理更多图像。

如何实现的?尽管Larzul没有提供确切的细节,但他确实表示它们不依赖修剪,因为精度降低太大,以至于不进行重新培训就无法接受。由于相同的原因,它们不使用极限量化(低于8位)。

Zebra的引擎加快了CNN的速度,而CNN如今已广泛用于图像和视频处理应用程序,但Zebra也可以应用于使用类似数学概念的BERT(Google的自然语言处理模型)。Zebra的未来迭代可能会覆盖其他类型的神经网络,包括LSTM(长期短期记忆)和RNN(递归神经网络),但这很难实现,因为RNN在数学上更加多样化。

EVE

Mipsology的团队成立于2015年,在法国约有30人从事研发工作,在加利福尼亚有一个小团队,主要负责业务发展。该公司已获得总计700万美元的资金,其中200万美元是2019年法国政府创新竞赛的奖金。

Mipsology的核心团队来自EVE,这是一家ASIC仿真器公司,于2012年被Synopsys收购,用于其ZeBu(零错误)硬件辅助验证产品,当时是Cadence钯金验证平台的竞争对手。Larzul认为,几乎所有主要的ASIC公司都使用EVE威廉希尔官方网站 在设计周期内验证ASIC。该威廉希尔官方网站 依赖于连接在一起的数千个FPGA来重现ASIC行为。

Mipsology拥有12项正在申请的专利,并且与Xilinx密切合作,并且与第三方加速器卡兼容,例如Western Digital小型(SFF U.2)卡和Vega-4001等研华卡。

-

FPGA

+关注

关注

1629文章

21735浏览量

603156 -

gpu

+关注

关注

28文章

4735浏览量

128919 -

AI

+关注

关注

87文章

30830浏览量

268984

发布评论请先 登录

相关推荐

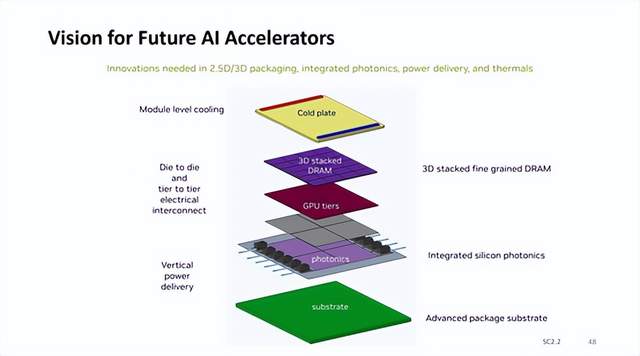

英伟达AI加速器新蓝图:集成硅光子I/O,3D垂直堆叠 DRAM 内存

《算力芯片 高性能 CPUGPUNPU 微架构分析》第3篇阅读心得:GPU革命:从图形引擎到AI加速器的蜕变

英特尔发布Gaudi3 AI加速器,押注低成本优势挑战市场

下一代高功能新一代AI加速器(DRP-AI3):10x在高级AI系统高级AI中更快的嵌入处理

美国限制向中东AI加速器出口,审查国家安全

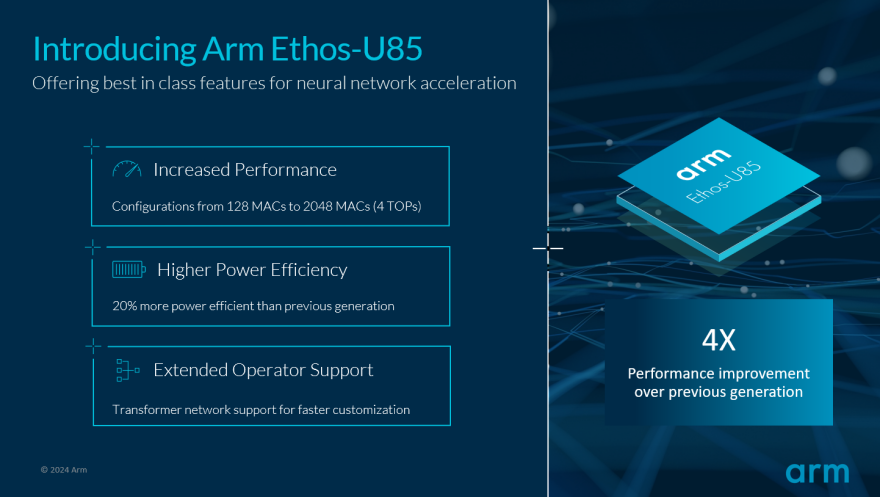

Arm推动生成式AI落地边缘!全新Ethos-U85 AI加速器支持Transformer 架构,性能提升四倍

Hitek Systems开发基于PCIe的高性能加速器以满足行业需求

FPGA取代AI加速器中的GPU

FPGA取代AI加速器中的GPU

评论